深圳商报·读创客户端首席记者 王海荣 通讯员 鹏信聚富配资

鹏城实验室近日联合清华大学研制成功首个国产算力下全开源模型“鹏城·脑海-2.1-开元-2B”(以下简称“脑海2.1-开元2B”),该模型在“中国算力网”核心节点“鹏城云脑Ⅱ”(国产芯片生态)上进行训练数据清洗、去重和训练的全流程,并完全公开过程和代码,不仅为“中国算力网”和业界提供了一条可复现、可迭代的模型全流程透明技术路径,也解码了在国产算力平台上实现高效、稳定预训练的完整解决方案。

据介绍聚富配资,“脑海2.1-开元2B”作为“鹏城·脑海”系列大模型的重要成员,是继推出大规模200B模型和对标GPT-4 Turbo的33B中等尺寸长窗口模型之后,进一步在全球大模型领域开放平台Hugging Face上全开源的2B新版模型。与现有大量模型仅开源权重不同,该模型公开了训练数据、清洗和配比工具以及模型权重和技术报告等核心“秘诀”,助力开源生态发展,训练中涉及的所有原始数据集均具有宽松的开源协议,个人、院校、企业、科研机构等均可自由使用。

鹏城实验室1月4日发布消息称,该模型跨越了“从粗放到集约”“从开源权重到开源过程”的国产模型里程碑,依托“鹏城云脑”大科学装置为代表的全国产算力与全生命周期工具链,为自主创新AI生态铺路,切实普惠开发者和用户。针对当前高质量开源数据稀缺、国产算力芯片训练不稳定以及开源模型训练方案“黑盒化”等难题,此次推出的“脑海2.1-开元2B”的研发实现了全国产算力上精炼数据高效训练的自主可控技术路线。

其中在数据混合与处理框架方面,解决了海量异构数据质量评价标准不统一及处理效率低的问题;在训练策略与超参配置方面,克服了有限算力资源下高质量数据利用率不足的挑战;在稳定训练与模型架构方面,突破了某国产算力芯片(FP16精度)环境下梯度溢出和数值不稳定的瓶颈。

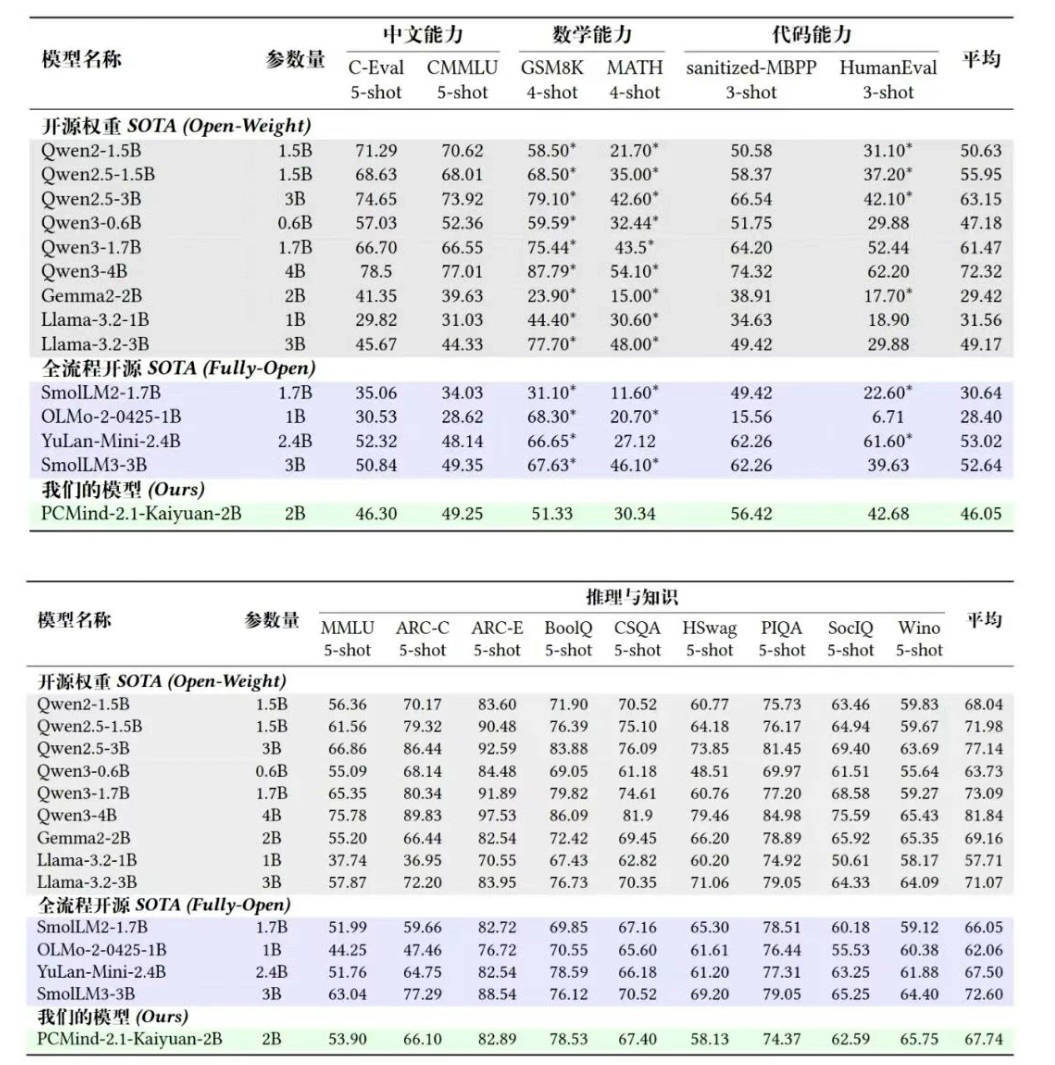

图片说明:“脑海2.1-开元2B”与国内外同规模模型基准测试得分表。 (图片来源于受访单位)

图片说明:“脑海2.1-开元2B”与国内外同规模模型基准测试得分表。 (图片来源于受访单位)鹏城实验室表示,目前,“脑海2.1-开元2B”评测结果已达到同规模全开源模型领先、部分指标接近主流闭源方案的水平。在核心能力(数学、代码、中文)评测中,该模型在MATH(30.34)、HumanEval(42.68)及CMMLU(49.25)等指标上显著超越了SmolLM2-1.7B及Gemma2-2B等国际主流全开源模型。在通用推理与知识方面,其平均分达到67.74,以更少的参数量实现了与更大规模模型相当的性能。

1月5日,记者从鹏城实验室获悉聚富配资,下一步,鹏城实验室将依托“鹏城云脑Ⅱ”和建设中的新一代国产智能算力“鹏城云脑Ⅲ”,持续开展基于全开源数据和国产算力训练高水平全开源大模型,并依托“中国算力网”,部署包括全开源模型在内的国产开源模型,为千行百业提供开源开放的模型与算力支撑。

举报/反馈配资天眼提示:文章来自网络,不代表本站观点。